Die digitale Revolution Teil 1: Grundlagen und technologische Entwicklungen

20.01.2019 //Digitale Revolution – diese Wortkombination lässt dem einen oder anderen gestandenen Treuhandunternehmer das Blut in den Adern gefrieren. Und in der Tat: einschlägige Studien sagen das Wegfallen einen Grossteils der kaufmännisch-administrativen Jobs bevor. Einer Untersuchung der renommierten Oxford Universität zufolge, soll sogar die Profession des Buchhalters in den nächsten Jahren mit einer an Sicherheit grenzenden Wahrscheinlichkeit komplett automatisiert werden.

Um Klarheit in dieses augenscheinlich unschöne Szenario zu schaffen, werden wir in dieser dreiteiligen Serie Antworten geben, ob die gefühlte Beschleunigung der technologischen Entwicklung auch tatsächlich messbar stattfindet und wie sich Treuhandfirmen oder KMUs optimal auf die Digitalisierung vorbereiten können. Im ersten, vorliegenden Teil starten wir mit den Basistechnologien, die zu dem geführt haben, was wir heute umgangssprachlich als „digitale Revolution“ bezeichnen.

Was Reiskörner mit der digitalen Revolution zu tun haben

Um zu verstehen, wieso es nicht nur gefühlt, sondern tatsächlich immer schneller geht, kann das Mooresche Gesetz eine nützliche Erklärung liefern. Dieses wurde bereits in den 70er Jahren aufgrund Moore’s Feststellung so benannt, da sich die Komplexität integrierter Schaltkreise alle 12-24 Monate verdoppelt[i]. Der Zeitraum wurde in der erwähnten Bandbreite immer mal wieder etwas angepasst und das Ende des Gesetzes wurde schon mehrmals vorausgesagt. Tatsache ist aber, dass es bis heute anhält, ein baldiges Ende nicht absehbar ist und sich generell auf IT Kapazitäten anwenden lässt. Dieses Gesetz ist eine einfache, mathematische Exponentialfunktion. Bekanntlich tut sich das menschliche Gehirn schwer damit. Sie erinnern sich vermutlich an die Geschichte, in der dem angeblichen Erfinder des Schachspiels ein Wunsch freigegeben wurde[ii]. Er wünschte, es solle ein Reiskorn auf das erste Feld des Schachbretts gelegt werden, auf das zweite deren zwei, auf dem dritten deren vier und so weiter. Auf jedem Feld soll die doppelte Menge des vorangehenden Felds gelegt werden. Das gleiche Prinzip wie im Mooreschen-Gesetz also. Der Wunsch wurde ihm gewährt, weil intuitiv niemand verstand, dass alleine auf dem letzten Feld sage und schreibe 9‘223‘372‘036‘854‘775‘808 Reiskörner zu liegen kommen. Aus dieser Geschichte lernen wir, dass sich eine exponentielle Entwicklung zu Beginn noch verhältnismässig harmlos verhält, dass aber ab einem bestimmten Punkt – im Beispiel des Schachbretts etwa bei der Hälfte – eine weitere Verdoppelung zu einer immer gewaltigeren Steigerung führt. Und genau da stehen wir nun mit den IT Kapazitäten. Inzwischen sind rund 30 Verdoppelungen der Kapazitäten erreicht und ein Ende ist nicht in Sicht. In Gegenteil: es gibt weiterhin immer mehr für immer weniger Geld und das immer schneller.

Explodierende Speicherkapazitäten

Die Netzwerkkapazitäten sind mittlerweile hoch genug, um auch sehr grosse Datenmengen in kurzer Zeit zu übermitteln. Am 6. August 1991 erblickte die erste Website am CERN, der Europäischen Organisation für Kernforschung, in Genf das Licht der Welt. Möglich machte dies Sir Timothy John Berners-Lee, ein britischer Physiker und Informatiker. Er ist der Erfinder der Programmiersprache HTML und der Begründer des World Wide Webs, das damals noch etwas abschätzig als „world-wide-wait“ verspottet wurde. Doch seitdem ist viel passiert. Heute ist es eine Selbstverständlichkeit sich über das Internet Spielfilme in hoher Auflösung anzusehen. Das weltweite Datenvolumen verdoppelt sich alle ein bis zwei Jahre, d.h. innerhalb dieser Zeit produzieren wir so viele Daten wie in der gesamten Menschheitsgeschichte zusammen und folgen damit ebenfalls dem Mooreschen Gesetz. Dies ist möglich geworden, weil die Speicherkapazitäten explodiert sind, massiv günstiger wurden und wir dank Miniaturisierung und starken Netzwerken überall und zu jederzeit Daten produzieren können.

Reduce to the max – wenn 4000 Transistoren auf ein menschliches Haar passen

Eine weitere technologische Entwicklung, die unverkennbaren Einfluss auf die heutige zunehmende Digitalisierung der Welt hat, ist die zunehmende Minimalisierung von Strukturen unter Beibehaltung der Funktion. Diese führt dazu, dass leistungsfähige Rechner in kleinste Geräte eingebaut werden, welche überall hin mitgenommen werden können. Wie gewaltig die Entwicklung in den letzten Jahren war, ist schwierig zu erfassen, lässt sich aber an folgendem Beispiel schön illustrieren: Der erste im Jahre 1947 von den Bell Laboratories gebaute Transistor konnte noch per Hand montiert werden. Heute passen über 4000 Transistoren auf die Breite eines menschlichen Haares, sie sind somit rund vier Mal kleiner als das Influenzavirus. Wollte man Transistoren von blossem Auge sehen, müsste der Chip grösser sein als ein Haus.

Entkoppelung durch Virtualisierung

Die heutigen Virtualisierungstechnologien haben nun das ermöglicht, was wir heute mit dem etwas überstrapazierten Begriff „Cloud-Computing“ benennen. Virtualisierung entkoppelt Hardware, Betriebssysteme, Daten und Anwendung in der IT Infrastruktur. Eine virtuelle Maschine ist ein Stück Software, das ein Betriebssystem und Anwendungen genauso wie ein physischer Computer betreibt. Damit wird ermöglicht, verschiedene Systeme auf derselben Hardware zu betreiben und einem Benutzer anzubieten, ohne dass dieser über eigene Systeme verfügen muss. Dank einer mächtigen IT-Infrastruktur und der daraus resultierenden Skaleneffekte lassen sich beträchtliche Kostenvorteile erreichen. On Top wird ein neuer Grad an Flexibilität erreicht, da sich IT Kapazitäten jederzeit auf sich ändernde Bedürfnisse anpassen lassen. Diese Technologien haben neu gegründeten oder branchenfremden Unternehmen erlaubt, neue Geschäftsfelder schnell zu erschliessen und bestehende Anbieter in Bedrängnis zu bringen.

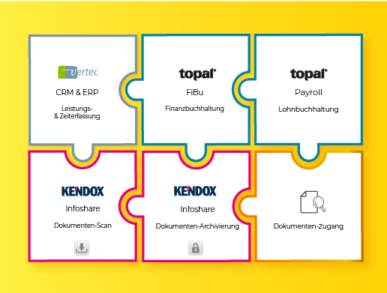

Bloss nicht aus allen Wolken fallen: Public vs Private Cloud

Es sind zwei Ausprägungen der Cloud zu unterscheiden: Die Public Cloud einerseits, die durch riesige Datacenter von globalen Grosskonzernen wie Amazon oder Google charakterisiert sind. In diesen teilen sich eine Vielzahl von Benutzern die gleichen Komponenten wie z.B. Server oder Datenbanken. Andererseits die Private Cloud, die zwar auf denselben Technologien und Konzepten basiert, die aber immer dediziert für einen Kunden angeboten wird. Das heisst, ein Kunde verfügt immer über seine eigenen virtuellen Server und teilt diese mit keinen Drittparteien. Eine solche Private Cloud lässt sich genauso in einem ausgewählten Schweizer Datencenter wie auf der hauseigenen Infrastruktur einer Firma betreiben. Diese beiden letztgenannten Optionen bieten sich ebenso für eine Treuhandfirma an. Mit einer Private Cloud kann ein hoher Standard für den Datenschutz und die Datensicherheit gewährleistet werden. Wir bieten unseren Treuhändern sichere Cloud-Lösungen an.

Und das nächste Mal: Plattformen essen die Welt

Den zweiten Teil der Serie widmen wir uns den Online-Plattformen, wie wir diese von globalen Anbietern wie Apple, Facebook oder Airbnb kennen. Im Zentrum steht die Frage, welche dieser Plattformen für Sie als Treuhandfirma relevant sind, was für Chancen und Risiken damit einhergehen und welche Strategien Sie sich zurecht legen können. Wo und wie Sie konkret Ihren Digitalisierungsprozess beginnen oder weiterentwickeln können, damit beschäftigen wir uns im dritten Teil dieser Serie.

Vorherige

Vorherige